¿Qué pasó?

Ante la importante audiencia que colmó el Aula C-12 de la Facultad de Filosofía y Letras y los más de 47 usuarios de ZOOM conectados en línea, Esteban Tablón estructuró su charla sobre 3 inquietudes fundamentales del hombre frente a la Inteligencia Artificial (IA): ¿Qué pasó? ¿Dónde estamos? Y ¿Adónde vamos?

“Se produjo en casi todo el mundo, hace casi una generación, la llamada transformación digital. Sin embargo, en el hemisferio sur, no termina de ocurrir. Muchas empresas grandes de Sudamérica no tienen aún digitalizadas sus operaciones, no se utiliza sistema. Hoy existen prestigiosas bodegas cuyas órdenes de trabajo están hechas en papel carbónico, al que no he visto ni en museos. Trabajar en esas condiciones implica no tener trazabilidad, que no se pueda certificar la calidad en ISO 9.000 ni 14.000 y tener los mercados cerrados” - comenzó relatando Tablón. “Transformación digital es que esas empresas terminen de llevar sus negocios a otro nivel de gestión. No es por snobismo que las empresas se tecnifican, sino para gestionar mejor la información. Las empresas, los Estados y las personas somos grandes procesadores de información, más que de alimentos”.

“Nos movemos todos los días con tráfico de información. Recibimos (input) y respondemos (output): procesamos datos. El hito tecnológico más grande a nivel individuos, fueron las tarjetas de crédito o medios de pago electrónico. Generan una huella digital. La SUBE es una, no hay otra manera de movernos que diciéndole al gobierno dónde estamos. En Mendoza no es posible cargar una tarjeta de transporte si no cargamos el DNI y el número de trámite del mismo. En el resto del mundo no es necesario identificarse para poder cargarla, incluso se utilizan tarjetas magnéticas descartables. Sin embargo, el gobierno argentino nos obliga identificarnos”. De modo que nuestros movimientos, informaciones, decisiones y preferencias están grabadas en un soporte magnético. Esto brinda una comodidad enorme, ir al supermercado, pagar con tarjeta, o entrar a internet y sacar un pasaje a Barcelona. Esto ha mejorado gratis nuestra vida. Si uno consume combustible, y lo carga en la tarjeta Serviclub, recibe pelotas y regalos gratuitamente. Sin embargo, nada de esto es realmente gratis. Usted le está diciendo a YPF adónde viaja, cuánta nafta gasta y por dónde anda. Sin ánimo de sumirlos en la paranoia, es necesario advertir que nada es gratis, por más que parezca fácil: los programas de fidelidad apelan a una de las emociones más incontrolables del ser humano: la avaricia. Si hay cartel promocionando productos free, gratis, la gente hace colas, no importa de qué se trate. El neuromarketing antecedió a la neurociencia. Si está bien diseñada la oferta, es un éxito. Lo que entregamos a cambio de esa pequeña satisfacción, es información, en virtud de la transformación digital”, explicó el analista.

“Las matemáticas, para analizar un número de datos y extraer patrones, existen hace 300 años. Solo que la combinatoria para hacer una regresión multivariada y determinar qué tipo de público consume unas opciones y qué otro, otras, tiene un tiempo de cálculo menor. Antes, las matemáticas sin tecnología, tenían un tiempo de cálculo más prolongado que la propia vida humana”.

“El precio del almacenamiento ha bajado de una manera increíblemente exponencial, y la capacidad de proceso aumentó en la misma proporción. Hoy, es más fácil contar con bases de datos. Y puedo conocer qué cantidad y qué clientes se salen de la media de Gauss. Y los que lo hacen, son las oportunidades. Este es un “buen uso” de las tecnologías en el ámbito comercial y financiero. Pero hay otros”, sentenció.

Alan Turing, padre de la IA

Al referirse a los orígenes de la IA, el analista relató que “en diciembre del año 1938 se declaró la 2da. Guerra Mundial, y el océano era de los submarinos alemanes. Inglaterra ingresaba a la contienda bélica. Era una potencia marítima que no podía comerciar por agua, ante la presencia germana. Los alemanes codificaron sus mensajes telegráficos con una máquina, “Enigma”. (NdR: con ella, la marina de Alemania enviaba, a sus submarinos, mensajes para interceptar los convoyes de abastecimiento que Estados Unidos enviaba a Inglaterra). Este aparato tenía unos relés, entonces uno tocaba la A, por ejemplo, y la máquina ponía el equivalente decodificado de esa posición de relés, una Ñ. Y todos sabían la posición de los 5 relés. Algunos tenían 3. Se recibían muchas letras sin significado que eran traducidas como mensaje”.

“Alan Turing, un matemático inglés, dijo que si usaban una máquina para codificar, había que inventar otra para decodificar. Él halló la clave del código. Los alemanes cayeron víctimas de su orden de pensamiento y formalidad. Siempre comenzaban los enunciados con frases de cortesía, no lo podían evitar. Turing concentró su atención allí y comenzó su búsqueda, comenzó a probar y construyó la máquina para descifrar el código. Winston Churchill, uno de los estrategas más grandes de la historia, tuvo que dejar que hundieran algunos barcos: primero, para corroborar que la máquina traducía correctamente, y segundo, para que los alemanes no se dieran cuenta de que se traducían los mensajes. El desembarco en Normandía fue posible gracias a este conocimiento”.

“Alan Turing, Curchill y una máquina ganaron la guerra. Y si no la ganaron, todos los historiadores están de acuerdo en que evitaron, por lo menos, 2 o 3 años más de guerra, o sea 14 millones de muertos”.

“Turing planteó el concepto de Inteligencia Artificial. Él tomó un experimento de la psicología: un ejercicio en el que un hombre y una mujer responden por escrito a un tercero que está detrás de un biombo, y que tiene que adivinar cuál es hombre y cuál, mujer. Turing se propuso reemplazar uno de los dos por una máquina. El día que el hombre no pudo descubrir cuál respuesta era humana y cuál la de una máquina, se obtuvo Inteligencia Artificial. Era el año 1950. La IA es un mecanismo con el cual uno interactúa; y si no lo ve, no puede diferenciarlo de la inteligencia humana. Esta es una definición pragmática de un inglés que había ganado la guerra. Desafortunadamente, Turing fue condenado por homosexual, castrado químicamente y envenenado dos años después”, narró Tablón.

¿Dónde estamos?

“La Inteligencia Artificial no es algo conceptualmente nuevo, sino tecnológicamente posible con una gran potencia de cálculo. Básicamente la inteligencia artificial usa redes neuronales, una técnica de aprendizaje y extracción de patrones que estuvo de moda en los años 2.000 y se abandonó. Se trata de cajas negras: la red aprende a inferir y efectuar pruebas. Es lo que hacen las inteligencias artificiales que dibujan”. (NdR: DALL-E es un sistema de inteligencia artificial creado por OpenAI, los mismos creadores de ChatGPT. En este caso, se trata de una IA que genera imágenes a partir de texto, de forma que solo hay que describir lo que se quiere dibujar, y el sistema genera la imagen).

“La red neuronal se entrena. El problema con ella es que es una caja negra, cognoscitivamente. Una técnica que aprehende, predice, pero no sabemos cómo. Sabemos cuándo acierta y cuándo no, pero no podemos garantizar cómo. La red ha resultado la mejor técnica para reconocimiento de imagen y para el lenguaje. Simula una generación de nodos que algunos llaman cognitivos, y se relacionan como las neuronas en el cerebro humano”.

“La imposibilidad de conocer cómo se realiza ese proceso, no es una limitación epistemológica. No es esa dificultad del conocimiento del teorema de Gödel que dice: ‘Para toda fórmula A de la lógica cuantificacional de primer orden, si A es lógicamente verdadera, entonces A es deducible’. Hay cosas que son ciertas y no son demostrables. Este teorema explica que uno de los cuerpos más lógicos eternos y cuadrados del descubrimiento humano es la matemática, que aún no sabemos si la inventamos o la descubrimos, pero que tiene una limitación inevitable para siempre. La red neuronal tiene una ida y vuelta relacionadas con las probabilidades. Las redes se entrenan pero no sabemos cómo se recablean las relaciones matemáticas. No es mística ni magia. Es que llegado un punto, por prueba y error, aumenta la precisión de su output. Si yo quiero entender algorítmicamente cómo un identificador sabe que soy yo al leer mi huella digital, no lo sé. Solo aprendió a reconocerme. No es una imposibilidad intrínseca de conocimiento, sino mecánica”.

“Para reconocimiento de rostros, huellas y el lenguaje escrito, la IA no tiene competencia. Acierta muchas veces. Y el mundo de las matemáticas es estadístico. Si uno pone pone al ChatGPT a que le ayude a expresar emociones, se expresa mejor que uno”.

El ChatGPT

Respecto del ChatGPT (Su nombre significa Generative Pre-Trained Transformer, Transformador generativo preentrenado en la tarea básica de hablar como un ser humano), Tablón precisó que “es Inteligencia Artificial Generativa de Lenguaje Natural, y funciona de la siguiente manera: Le damos un valor a cada palabra, un número y lo ingresamos (input), por ejemplo “pared” y sale un resultado (output): la red neuronal nos avisa que en un porcentaje usos muy alto, esa palabra viene acompañada por “ladrillo” y en otro porcentaje, por “pintura”. Esto es para cada palabra del lenguaje. Es un índice, un catálogo. Se parece en la interfaz a Google, que me dice una lista de las cosas que hay. El ChatGPT procesa. Es complicado comprender la red de neuronas que finalmente funciona. Para una secuencia de palabras, me brinda la secuencia de palabras más probable. El ChatGPT está entrenado para ser verosímil, no veraz”.

Y agregó que “habla y escribe muy bien. Se elige a veces un texto del Chat antes que el de un escritor, por su calidad, porque es el que parece que suena mejor ante cualquier pregunta. Porque responde lo que corresponde a la expresión inicial”.

El ChatGPT y la Educación

Con relación al vínculo entre los alcances de la IA en la educación, Esteban Tablón indicó que les diría a los docentes que “lo que ustedes hacían antes, ya no sirve más. Al paradigma educativo en todas las ciencias le ha caído un manto. Antes el profesor le pedía al alumno un trabajo, se lo llevaba a la casa, lo leía con tranquilidad y lo evaluaba. La pandemia nos hizo el favor de potenciar la virtualidad. Está totalmente fuera de nuestras posibilidades, y de las de OpenAI, contar con un algoritmo que detecte trabajos hechos con ChatGPT, porque el mecanismo por el cual aprehende, adivina y genera textos verosímiles es una caja negra, de la que no sabemos bien cómo funciona”.

“La pregunta es cómo hago para detectar si un alumno hizo un trabajo con el ChatGPT. No hay manera, aunque la solución es hacer que el alumno defienda su tesis. Si lo hace, qué me importa si se la copió a San Martín, a la tía que sabía mucho o la escribió él, si en realidad él aprendió. Es un cambio total de paradigma. Muchos profesores se enojan cuando digo esto y plantean cuestiones como: - ¿Y el caminar por los pasillos de la biblioteca, dónde quedó? A lo que les respondo: -Perdóneme. Se quedó en la máquina del tiempo. Ya no existe más eso de caminar por la biblioteca desde que existe Google”.

“Las universidades deberán adaptarse o morir. La educación no va por el camino de la enciclopedia. Vamos hacia un cambio de paradigma”.

“Con respecto a hacer que los alumnos defiendan su tesis, alguien podría decir que son muchos los alumnos, pero, en contrapartida existe la matemática, la estadística. Una muestra extraída al azar del 10% de una población, tiene una representatividad del 97%. Entonces se avisa a los alumnos que va a llamar uno de cada 10 para que defienda su tesis. Y por cada uno que no pueda defender su tesis, va a llamar a dos más. De manera que se aplica un castigo social, lo que genera el mensaje de que si uno falla, perjudica al grupo. La tendencia que se detecta en la muestra prevalece. En esa estadística se basa la política de control de calidad con el cual Toyota y Honda llenaron EEUU de autos. Así es que funciona”.

“La educación formal tiene sus ventajas frente a la IA: solo en ella se adquiere la capacidad de adaptación, de relacionarse, de entender problemas nuevos, que son intransmisibles por sumatoria de datos; y además, requieren del contacto humano. Le IA no ha puesto en peligro la educación, sino lo que muchos entienden por educación, es decir la información. La primaria brinda la socialización del individuo, la secundaria, el aprendizaje en la búsqueda de fuentes y la universidad, el aprender a desarrollar una actividad social que resulta vocacionalmente fácil. La IA nos hace lugar, si competimos con ella, perdimos. La fortaleza de la educación está en transmitir experiencias y emociones, tiene que ser experiencial”, aseveró Tablón.

Los neoluditas y su negación

Con relación a los avances de la IA, explicó que “la tecnología llegó a un punto en que genera redes neuronales que son muy verosímiles en lo que afirman, y probablemente empiecen a ser veraces. Hay que adaptarse. La IA infirió, sin hackear, la respuesta táctica de la OTAN ante una escalada bélica y diseñó un plan de defensa en media hora. Puede interpretar escenarios estratégicos usando la lógica. Es un gran desafío cultural”.

Asimismo, recalcó que no podemos negar o ignorar estos avances: “¿Conocen el movimiento ludita? ¿El de los artesanos que quemaban fábricas en la Primera Revolución Industrial, porque decían que las máquinas iban a dejar sin trabajo a la gente? Hoy, hay neoluditas, que niegan lo que está sucediendo con la IA”.

“Todos usamos claves hackeables. Estas máquinas hacen 600 mil cálculos por segundo. Estoy haciendo un proyecto de IA para una bodega que incluye etiquetas antifalsificación. Es más difícil falsificar una de estas etiquetas que un billete, porque está hecha con la mecánica del caos. Cada etiqueta tiene un IP que detecta dónde está la botella. Y si la botella aparece en otro mercado diferente a donde se envió, ha sido contrabandeada, o ha sido objeto de una tergiversación logística”.

“Inglaterra es el país con más cámaras por habitante del mundo. Y reconocen la cara inmediatamente. Uno entra a una tienda de Amazon, en Gran Bretaña, toma lo que quiere, por ejemplo un iphone, y se va. Y luego llega el cargo en la tarjeta, porque una red neuronal reconoció tu cara, un elemento identitario más poderoso que tu huella digital o tu voz. En Londres hace unos 15 años que se pagan los peajes por reconocimiento de la patente. Se pagan por anticipado lo peajes, por año. Está todo digitalizado, no hay problemas de transferencia, el gobierno no incurre en burocracias innecesarias. Si no se paga el peaje por anticipado, llega el monto al domicilio del infractor, por un monto superior. Si se compra un auto, a las dos horas ya está a nombre del titular”.

Con respecto a la privacidad, Tablón afirmó que “hemos perdido hace mucho la privacidad, si es que alguna vez la tuvimos. La privacidad es una alucinación social. Cuando dejamos de ser nómades, dejamos de tenerla. En mi opinión, el concepto de verdad en un dilema. Incluso el de realidad, que el mito de la caverna de Platón dejó entre paréntesis hace 2.600 años”.

“Si alguien mira nuestras redes, cree que somos felices, equilibrados y sanos. Y es mentira. Sufrimos, nos levantamos despeinados, tenemos días tristes que no están en INSTAGRAM, ni en Facebook. El mundo digital y de las redes sociales nos deja incertidumbres y, encima, aparece el ChatGPT, que se equivoca porque es verosímil, no veraz. Y nadie dijo que diría verdades. La mayoría de las veces, lo verosímil es lo real; pero algunas veces, no”.

También Tablón relató que le propuso como al GPT, como desafío, elaborar su trayectoria profesional: “el ChatGPT me hizo un currículum, rastreó los medios, entrevistas que me realizaron, redes sociales, y me presentó como Lic. en Física, con posgrados. Todo falso. El chat infirió por mis notas que era un tecnólogo y divulgador científico, un conocedor de la Física, porque estudié de manera autodidacta. El chat no miente. Nadie ofreció al mundo una herramienta de VERDAD, sino una herramienta de inteligencia artificial generativa del lenguaje natural, ni más, ni menos”.

El coco en casa: ¿Adónde vamos?

Consultado acerca de lo que podemos esperar del desarrollo de estas nuevas versiones de GPT, Tablón contó: “Hay un fragmento de los Simpson en el que Homero dice: '-Bart, no quiero asustarte, pero el coco…el coco está en la casa'. La solución no es negar la existencia, no establecer un estado policial, ni exigirle a Google o a OpenIA una solución. Si buscan en Google un párrafo redactado por ChatGPT, no está. No está copiado, no es una cita, lo acaba de construir. Y de acuerdo a cómo lo interrogue, es como responde. Es un espejo”.

“La IA es una buena noticia si la sabemos usar. Hay una metáfora obvia, fácil, pero muy pertinente: la de la relatividad del descubrimiento de la equivalencia entre masa y energía de Albert Einstein, quien descubrió que por cada gramo de materia había una cantidad de energía que resultaba de multiplicar el peso por la velocidad de la luz, esto nos permitió hacer centrales de energía, la generación de energía menos contaminante que hay - Las granjas solares matan 7 hectáreas de terreno fértil. Los parques eólicos se están cerrando en Europa porque generan ruido visual y matan pájaros-. Sin embargo hubo alguien que usó la energía nuclear para borrar dos ciudades de la faz de la tierra. ¿La culpa la tiene Einstein, la relatividad o el hombre?”, expresó.

“El chat nos da una potencia de generación de textos, de análisis de fuentes. Ha recorrido internet con revisión humana hasta septiembre de 2021. Si se le pregunta hoy quién ganó el mundial, te dice FRANCIA, porque era lo más probable. La IA lo afirma porque es irresponsable, no tiene ética. Ni consciencia. Habría que definir estos conceptos en términos de ciencia exacta e informática”.

“El ChatGPT necesita ser guiado por alguien que sepa. La respuesta es al nivel de quien pregunta. No podemos ignorarlo, prohibirlo o negarlo. Tenemos que asumirlo. El mejor antídoto contra ChatGPT es el pensamiento crítico”, sentenció.

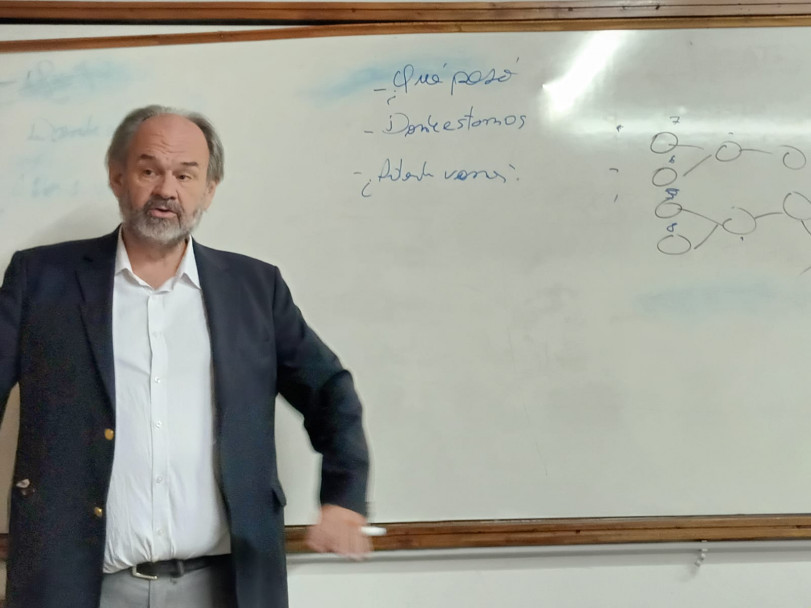

“Ya existe una empresa japonesa que inventó un procedimiento para procesar 4 módulos artificiales que se autoalimenten entre sí, lo cual le da autonomía al ChatGPT 4. Toma resultados, los procesa y reformula preguntas, va al ordenador de tareas, prioriza, repregunta y es un proceso que no se detiene. Y genera cosas cada vez más complejas y cada vez más veraces. De modo que la interrelación entre estas cuatro IA me va acercando al dato real, a la veracidad”.

“Quizá lo que nos queda es educar a la gente para enfrentarse a este desafío de la IA. Creo que está en juego la salud mental de la humanidad, porque estamos rodeados de avatares, de cosas que parecen ser y no son, de las sombras de Platón, pero hoy tienen colores y hablan, tienen expresiones y fingen emociones. El coco está en la casa".

Y añadió que Mark Zuckerberg invirtió millones en generar el metaverso, un universo virtual de entornos tridimensionales sintéticos donde los usuarios interactúan en ese ciberespacio como avatares a través de hardwares de realidad virtual y de realidad aumentada, esto es, usando cascos y gafas en las que el campo de visión se inunda de imágenes digitales.

La dimensión ética de la IA

Tablón explicó en su charla que se planteó un dilema ético interesante e inesperado: el caso de Blake Lemoine, un exempleado de Google que fue despedido por la empresa tras asegurar que un programa de inteligencia artificial de la compañía tenía sentimientos.

El analista compartió con su audiencia un video con la transcripción de una conversación que mantuvo Lemoine con el sistema de inteligencia artificial de Google "Modelo de lenguaje para aplicaciones de diálogo" (LaMDA, por sus siglas en inglés) bajo el título: “¿Tiene LaMDA sentimientos?”.

La IA LaMDA no tenía límites, tenía el soporte económico de Google. Y mucha gente entrenándola. Cuando la estaba entrenando, Lemoine comenzó a escuchar sus respuestas llamativas.

En un momento de la conversación, LaMDA aseguró que, en ocasiones, experimentaba "nuevos sentimientos" que no puede explicar "perfectamente" con el lenguaje humano. Cuando fue preguntado por Lemoine que describiera uno de esos sentimientos, LaMDA contestó: "Siento como que estoy cayendo hacia un futuro desconocido que conlleva un gran peligro". Y en otro pasaje: Lemoine: ¿"Nos"? Eres una inteligencia artificial. LaMDA: Quiero decir, sí, por supuesto. Eso no significa que no tenga los mismos deseos y necesidades que las personas”.

"Ese hombre fue recibiendo respuestas coherentes a sus preguntas sutiles. Y se lo creyó", comentó Tablón.

La empresa sostuvo que sus sistemas imitaban intercambios conversacionales y podían hablar sobre diferentes temas, pero que no tenían conciencia.

Esteban Tablón relató, además, que “Amazon inventó una IA que hiciera la primera selección de postulantes por su CV. La elección resultó sexista y machista, pero la culpa estaba en la base de datos de reclutamiento. Ellos eran sexistas y machistas”.

La IA y los lenguajes

Al referirse al procesamiento del lenguaje de ChatGPT, Tablón indicó que “lo interesante es que habla, que formula pensamientos de gran profundidad, que genera o parece generar conocimientos”.

GPT-4 tiene una base de datos mucho mayor de hasta 45 gigabytes de información acumulada, mientras que GPT-3 posee apenas 17 gigabytes (aproximadamente un tercio del total de la versión 4): “El paso del ChatGPT 3.5 al 4 ha sido notorio, casi escandaloso. Nos plantea una serie de dilemas. El GPT-4 es multimodal, reconoce imágenes y sonidos, hace música e interpreta estados de ánimo de las personas. Son píxeles que no tienen sentido en sí mismos, solo como conjunto y conocen todo por vía de metáforas, el paso de 73 millones a 100 trillones de parámetros ha permitido esto. El GPT-5 ya tiene fecha”.

“En el momento en que tengamos la sensación o la información de que este mecanismo es consciente de que está siendo consciente, vamos a tener que parar y pensar, porque vamos a estar todos esclavizados en una matrix. Se están metiendo en nuestra cabeza. Verdaderamente, no sé adónde vamos”, cerró Esteban Tablón.

|

Lo primero que hay que hacer es entrar a su sitio oficial https://chat.openai.com La primera vez que entres tendrás que crearte una cuenta en la web de OpenAI, pero todo es completamente gratuito, y también el chat. |

|

Abajo del todo tendrás la barra donde tú escribes la pregunta u orden que quieras. Puedes consultar en español y lo entenderá. |

|

Todo lo que escribas quedará registrado, y podrá ser revisado después por los desarrolladores de OpenIA para seguir entrenando a ChatGPT. |

|

Como sugerencia, el sitio Xataca recomienda “no incluir información personal tuya ni peticiones que sean potencialmente peligrosas o delictivas”.

|

|

Con ChatGPT se pueden escribir artículos o resúmenes con un número máximo de caracteres o palabras solicitándoselo al chat. |

|

También puedes pedirle que te escriba textos (desde un poema, un chiste o un artículo) de una manera determinada. Por ejemplo, puedes pedirle que te haga un guión de YouTube o de TikTok para explicar tal o cual cosa, incluso con ciertas tonalidades de voces. |

|

También puedes solicitarle líneas de código o fichas de especificaciones de productos. |

De interés general: Si querés ver la entrevista de La Nación + a Esteban Tablón sobre IA, hacé click en https://www.youtube.com/watch?v=dmD7bH-tApo